כמו לכל המצאה מטורללת של האנושות, גם לדיפ פייק, הטכנולוגיה שמלבישה את הפנים של כל מי שתרצו על כל מי שתרצו, העולם כבר הספיק להתרגל. מארק צוקרברג כבר "התוודה" על המזימות שפייסבוק זוממת כדי לשלוט בגולשיה, דונלד טראמפ הספיק להשתלב בקאסט של "שובר שורות" וג'ניפר לורנס דיברה כשהפנים של סטיב בושמי מולבשים על הפנים שלה. התופעה הגיעה גם ללב המיינסטרים הישראלי, כשכל חברי הקאסט של ארץ נהדרת הוצגו כשהפנים של חברי הכנסת שאותם הם מחקים מולבשים על פניהם - ובשבוע שעבר, כשספי ריבלין הוקם לתחייה לצורך קמפיין גיוס תרומות לאגודה למלחמה בסרטן. עד 2017 רק מומחים יכלו ליצור סרטונים כאלה, אבל אז אנשים החלו להפיץ סרטונים שעשו בעצמם בעזרת אפליקציות. ואז, באינטרנט כמו באינטרנט, מישהו הבין שאפשר לעשות מזה גם פורנו.

כך בא לעולם הדיפ ניוד, שעושה משהו מאוד דומה - רק בעירום. מדובר בטכנולוגיית אינטליגנציה מלאכותית די פשוטה, שסורקת את תוואי הגוף של התמונה ומפשיטה ממנה את הבגדים. כל מה שצריך, לא שאנחנו ממליצים, זה להכניס תמונה לתוך האלגוריתם ולקבל ניחוש - כנראה מוצלח למדי - של איך אותו אדם ייראה בלי בגדים.

הדיפ ניוד החל את דרכו כאפליקציה שניתן להוריד תמורת חמישים דולר, להכניס לתוכה כל תמונה שתרצו, ולקבל את אותה התמונה בגרסה העירומה. האפליקציה הייתה זמינה להורדה לפרק זמן לא ארוך, עד שאתר התחקירים VICE עלה עליה, כתב עליה באריכות - והופ, היא נעלמה. לטענת מפתחיה היא הוסרה בעקבות עומס משתמשים וגם כי הם פתאום קלטו שאנשים יכולים לעשות בזה שימוש לא מוסרי, וזו לא הייתה הכוונה שלהם. זה בטח סתם צירוף מקרים שהמוסריות שלהם התגלתה מיד אחרי שפרסמו עליהם כתבה ענקית.

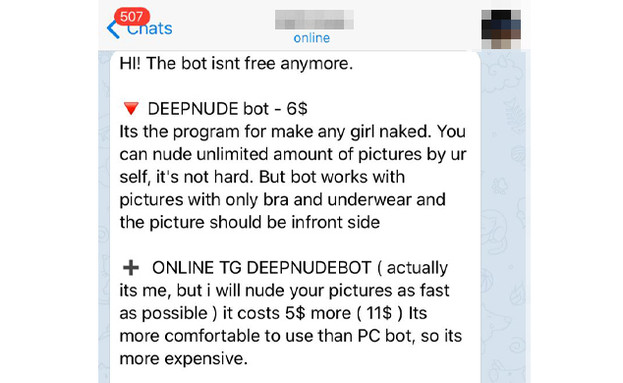

יהיו הסיבות אשר יהיו, אלוהים סגר את הדלת לאפליקציה הזאת אבל פתח חלון סליזי אחר: אתר שמפשיט תמונות באותה הצורה לכל מי שמבקש. התמונה שמתקבלת מגיעה עם סימני מים שמסגירים שהיא עברה טיפול, וכדי להוריד אותם תצטרכו לשלם עשרים דולר לחודש. מי שמוצא את המחיר הזה יקר מדי, יכול להיכנס לטלגרם. שם, מגוון ערוצים שמיועדים רק לנושא הזה מאפשר לאנשים לשלם דולרים בודדים, ובוט יפשיט עבורם כל תמונה שרק ירצו. פנינו למפעיל ערוץ כזה כדי לשאול איך הבוט עובד. הוא ציין שהבוט עולה אצלו שישה דולר ועובד על כל תמונה בביגוד תחתון או בבגד ים. כמו כל נותן שירות טוב הוא שמח לסייע, הסביר כמה זה פשוט לתפעול אבל הוסיף: "אם אתם רוצים להיות בטוחים שיצא לכם טוב, תמורת תשלום של 11 דולר אני אישית אפשיט בשבילכם את התמונות". רגע לפני שחסם אותנו כשביקשנו ממנו להתראיין לכתבה, המפעיל סיפר שיש לו אפילו כמה לקוחות מישראל, ומשתמשים "רבים ומרוצים" מרחבי העולם. מה שבטוח, יש דורשים. עד יולי 2020 יותר ממאה אלף תמונות כאלו כבר יוצרו.

זה כמו להכין פצצה ביתית

לפי אורי אליאבייב, יועץ בתחום הבינה המלאכותית ומייסד קהילת MACHINE DEEP LEARNING ISRAEL (למידת מכונה עמוקה), הרעיון בבסיס האפליקציה לא מקורי. "שינוי תמונות, אפילו על ידי אמצעים פשוטים כמו פוטושופ, קיים כבר המון זמן. החידוש הוא בקלות ובזמינות". כדי ליצור את התמונות האלגוריתם משתמש בלמידת מכונה. לימוד מכונה הוא האופן בו כשאתם מחפשים בחיפוש התמונות של גוגל חתול, אתם פשוט מקבלים תמונה של חתול. המחשב עובר על מיליוני תמונות ומקטלג אותן, וכך יודע לזהות עצמים. "במקרה של דיפ ניוד, האלגוריתם עבר על המוני תמונות של אנשים עירומים שאגר מרחבי הרשת, ואז משלים איך שנראה לו. לכן הוא גם יודע לזהות את התנוחה בה האדם בתמונה נמצא ולהשאיר אותו באותו מנח, רק להוריד ממנו הבגדים", מסביר אליאבייב ומוסיף, "לא צריך להיות מתכנת גדול כדי ליצור את זה. יש קודים שמשוחררים על ידי חברות גדולות כמו פייסבוק, גוגל ואמזון למטרות קבוצות מחקר ופתרון בעיות, אבל אנשים משתמשים בהם למטרות אחרות, לעתים לא חיוביות. אותו מתכנת לקח את האלגוריתם והתאים אותו. זה כמו להכין פצצה ביתית. כן, אתה צריך למצוא את החומרים, אבל ברגע שיש באינטרנט את המדריך להכנת הפצצה - שם הסכנה האמיתית".

אליאבייב אומר "אנשים עירומים", אבל קל להבין שהנפגעות העיקריות יהיו נשים. למעשה, אם תנסו להכניס תמונה של גבר לתוך הבוט המפשיט, היא ככל הנראה תחזור אליכם בעירום עם חזה ואיברי מין נשיים. "זה כנראה כי ההכוונה שלו הייתה רק לנשים. האלגוריתם יודע לבצע את הפעולה שהוא אמור לעשות, במקרה הזה להפשיט, רק על פי הנתונים שניתנו לו. אם הוא עבר רק על תמונות נשים, הוא לא ידע איך גבר נראה", אומר אליאבייב. לפי פרופ' דפנה הקר, ראש תוכנית המגדר באוניברסיטת תל אביב, ברור שהאלגוריתם מחפש רק נשים, משום שעצם הרעיון של דיפ ניוד יכול להיווצר רק אצל גברים. "הרבה מאוד גברים מתחנכים מגיל מאוד צעיר להגדיר גבריות כמימוש סיפוקים מיניים. עם כמה נשים שכבת, איך עשית את זה. לכן הסיפוק אף פעם לא נעצר. יש פורנו, אז מה הדבר הבא. זה חיפוש ילדותי ושטוח שהפך להיות סממן לגבריות".

אז מדובר בניסיון לממש גבריות, ולא, נניח, בחרמנות גרידא?

"שימוש שכזה בתמונות ללא אישורה של אישה הוא הרבה מעבר לחרמנות. גבריות מבוססת על כוחניות. גבר אמיתי, כך חונכנו, הוא זה שלוקח מה שהוא רוצה. נעשה מחקר שגילה כי בגילאים צעירים ילדים בנים תוקפים מינית גם בנים וגם בנות. מכיוון שבקרב הבנים הם חווים יותר התנגדות, בנים לומדים בגיל מאוד צעיר שעדיף לתקוף אישה. מן הצד השני, האישה לומדת שהיא חלשה ושכל שהיא יכולה לעשות הוא להתגונן. האפליקציה הזו והשימושים בה הם לא רק שאלה אישית לגבי המשתמשים בה, אלא גם ביטוי לחברה חולה. זה שגברים מוצאים עניין בלקחת תמונות של נשים ולהפשיט אותן בצורה כזו זה חלק מתרבות הפורנוגרפיה. אין התייחסות לאישה כאדם. יחסים בין המינים כשקבוצה אחת בין המינים מתייחסת לשנייה לא כאדם, אלא כחפץ. יש פה חילול של הכבוד שלה כבן אדם, זה לקחת מהאישה את האוטונומיה של להחליט מול מי היא מתפשטת. וזה לא נשאר במרחב וירטואלי. זה מחלחל לאינטראקציות במרחב, בחדר המיטות. המחקרים מראים לנו כמה יותר ויותר גברים דברים לוקחים מין לא ברצון. וכמה נשים מחונכות שהרצון שלהן לא משמעותי".

רק לשימוש אישי, ולשימושם האישי של עוד כמה חברים

רוב השימוש בתמונות המתקבלות הוא פרטי, כך לפחות קבע דו"ח של חברת האבטחה סנסיטי שחקרה את השימוש בבוט המפשיט בטלגרם. עם זאת, לפי דבריה של פרופ' הקר, קיים חשש יותר מסביר שאנשים לא יסתפקו בלשמור את התמונה במחשב שלהם, יפיצו אותה ואף ישתמשו בהן כדי להטריד ואף לסחוט אנשים. שוב, בעיקר נשים. שימוש כזה בתמונות הוא רק אחת מפגיעות סייבר שנכנסות תחת הכותרת "אלימות מבוססת תמונות". ההגדרה הזו נוגעת לכל הפצת תמונות אינטימיות של אדם ללא אישורו. השימוש הישן והמוכר ביותר הוא כמובן הפצת תמונות עירום אמיתיות; כבר שנים שאנחנו שומעים נשים ונערות המספרות על אקסים שהפיצו תמונות או סרטונים שצילמו יחד בזמן שהיו זוג. ויש כמובן גם מדיה שמתועדת ללא ידיעת המצולמת.

למרות הדגש על נשים, גם גברים נפגעים מכך. אלון (שם בדוי) בן 32, מספר כי פגש נערה בצ'אט של משחק און ליין, היא הציעה לו שיתפשטו יחד במצלמה ויגעו בעצמם. "הסכמתי בלי לחשוב" הוא מספר, "אתה שומע על הרפתקאות כאלו ומתרגש כשזה קורה לך". חמש דקות לאחר המעשה קיבל אלון מייל עם תמונות שלו מהסיטואציה ודרישה שיעביר אלפיים שקל לחשבון בנק תוך 24 שעות, אחרת התמונות שלי יופצו באינטרנט. "פניתי למשטרה והם אמרו שאין באמת מה לעשות. הם יכולים לחפש את האדם אבל זו בדרך כלל הסוואה שמובילה להסוואה וייקח הרבה זמן לאתר אותו. אז שילמתי את הכסף". על פניו נראה שנגד סחיטה כזאת ניתן להתגונן על ידי זהירות מוגברת: אל תצטלמו בעירום, אל תשלחו תמונות עירום וכן, תשתדלו לשמור את החלונות והדלתות סגורים כשאתם מסתובבים עירומים. אבל אז הגיעה הטכנולוגיה ואפשרה למי שרוצה להתבריין דרך חדשה לעשות את זה.

בכל אתר פורנו ישנם סרטונים בכיכובן של שחקניות מפורסמות, שאינם אמיתיים. הפנים של גל גדות, למשל, הולבשו על פניה של שחקנית פורנו וכך נראה שהסרט הוא בכיכובה. הפעילה החברתית נואל מרטין סיפרה למגזין "אל": "קיבלתי מייל שבו היה כתוב 'יש סרטוני דיפ פייק שלך'. ראיתי אישה מקיימת יחסי מין עם גבר. הפנים שלה פנו למצלמה, ואלו לא היו פנים זרות. אלו היו הפנים שלי". מרטין ניסתה להוריד את הסרטון וסרטים דומים שנעשו עליה מכל אתר שבו הן הופיעו. "שלחתי בקשות למנהלי האתרים. חלק הסכימו, חלק לא ענו ואחד אפילו אמר שיוריד רק אם אשלח לו תמונות עירום אמיתיות שלי". מרטין הבינה שהדרך היחידה ללחום בנושא היא משפטית. היא החלה מאבק שבסופו הוחלט שאלימות מבוססת תמונות הינה פעולה לא חוקית. בארצות הברית, למשל, מנהלי אתר שהעלה סרטונים כאלה נשפטו למאסר של 18 שנים, וזה אחלה, רק שהקלות שבה ניתן לעשות סרטונים שכאלה גדלה מאוד. אפליקציית DEEPNUDE אמנם ירדה מהרשת, אבל FACEAPP, ששמה את הפנים שלכם על פנים של כוכבי קולנוע ומשלבת אתכם בקטעים מסרטים, קיימת וקלה מאוד לשימוש. ואם כל כך קל לשים את הפנים שלכם על רוברט דאוני ג'וניור, מי מונע את האפליקציה הפשוטה הבאה שתמקם אתכם בכל סרטון פורנוגרפי באותה קלות? ואיך נוכל לעקוב אחרי כל משתמש שייצור סרטון כזה ואז יפיץ את הסרטון בין כל חבריו, כדי להעמיד אותו לדין?

"לעניות דעתי, הפצת הסרטים היא לא הבעיה היחידה", טוען ד"ר רועי צזנה, חוקר עתידים במרכז בלווטניק הבינתחומי וחוקר בכיר באקספרייז, ארגון בינלאומי היוזם תחרויות בנושאים שישפרו את חיי בני האדם. "אני חושב שללא מעט אנשים יפריע עצם הרעיון שמישהו מחזיק בתמונות עירום שלהם ללא אישורם. אנשים ייפגעו מתחושת אובדן הפרטיות ואובדן השליטה. האם זה רציונלי? לא ממש. האם זה מובן? לגמרי. גם כשאני העליתי תמונה של הילד הקטן שלי חצי עירום לפייסבוק גרמו לי להוריד אותה בתואנה שפדופילים יכולים להנות ממנה. בתיאוריה, מה אכפת לי מה אדם עושה עם תמונה בביתו הפרטי. במציאות הורדתי את התמונה כי זה הפריע לי".

יש מה לעשות מבחינה חוקית נגד שימוש באפליקציות כאלה?

"אפשר לעצור את זה עם חוקים, אבל הם בהחלט יפגעו בדמוקרטיה. קח לדוגמה את סין. חומת האש סביב המדינה לא מאפשרת שימוש בשום דבר שהמדינה לא מאשרת. מי שנתפס מנסה לצאת לפעולה נגד זה, נכנס למאסר. בדמקורטיה שעודנה דמוקרטיה אפשר לומר שהפצת תמונות שכאלו הינה אסורה על פי חוק, אבל שימוש אישי יימשך גם אם האפליקציה תוצא מחוץ לחוק. הרי מותר לי לצייר על תמונה, מה ההבדל אם בינה מלאכותית נותנת לי ניחוש לתמונה? הבעיה היא שהטכנולוגיה הזו יותר מזיקה מנשק. מה שהכי חשוב לנו כחברה זה האינטראקציה בין בני אדם, היכולת לחיות יחד ולעבוד יחד. ברגע שכל אדם יכול לראות כל אדם ערום זה מוביל לשינוי עמוק בחברה שלנו".

מה אפשר לעשות כדי להתגונן?

"אולי העניין יוביל לתנועת נגד שבה אנשים לא יעלו תמונות לרשת החברתית, או יעלו תמונות רק לחברים הקרובים. אופציה אחרת היא שאנשים יקבלו את זה שדברים כאלה קורים, ואולי בנות אפילו יחושו שהן יכולות ללכת איך שהן רוצות כי כבר אין מה לעשות. אופציה שלישית היא בדיוק הפוכה - אנשים, בעיקר נשים, יתלבשו הרבה יותר חסוד. תלבושות ויקטוריאניות, בורקה. מה שאפשר כדי להסתיר כל תוואי גופני כדי שאף תוכנה לא תוכל לנחש מה נמצא מתחת. אני מקווה דווקא לאפשרות רביעית. אנחנו, בני האדם כולם, מתרגלים מהר לשפע ומחפשים מה חסר. יש לנו כבר אייפון, אז אנחנו רוצים את המכונית המעופפת. ברגע שיש שפע של עירום, אנחנו מחפשים את המחסור. צורה אחת, כאמור, יכולה להיות האדם החסוד, הנסתר. הצורה האחרת, שאליה אני מקווה, היא שגברים יתרגשו פחות מלראות גופות ערומים ויתרגשו יותר ממושא האהבה שלהם, ממשיכה מינית עם רגש. במקום פורנו, יבוא רצון בקשר ממשי, אוהב, מספק באמת".

גבר הולך לאיבוד

תפיסת העולם האופטימית הזו נעימה מאוד לאוזניים, אבל עד שזה יקרה, אליאבייב חושב שיקרו דברים גרועים יותר. "השלב הבא הוא שליטה יותר טובה על הסצנה. כרגע, די ברור שהסרטונים מזויפים. קוראים לזה מבחן הפיד; אני גולל, רואה סרטון, האם ברור לי שהוא מזויף. כרגע, כמעט בכולם זה ברור, כאשר בעתיד הזיוף יהיה הרבה פחות ברור. העולם הזה יתפתח לסרטונים בהזמנה, שבהם האנשים יעשו כל מה שהמתכנת, ובהמשך כל משתמש, יוכל רק לחשוב עליו. לא רק לחפש סרטון קיים ולהוסיף לו פנים, אלא ממש להציב את הפנים והגוף באיזו צורה שתרצה. בנוסף, יהיה גם קול. כבר היום ניתן לדגום קטעי קול של אנשים ומהם ליצור כל משפט שרוצים, אבל זה עדיין בגדר עבודה שרק מתכנתים יכולים לעשות. עם זאת, דיפ ניוד כבר לימד אותנו שהכל הולך לכיוון של פשטות שימוש".

אז יש מה לעשות?

"יש משפט בתורת הלחימה שאומר: קו ההגנה תמיד יישבר. אין דרך באמת למגר את זה. יש הרבה משאבים כדי לפתח אלגוריתמים לזהות סרטון מזויף. פייסבוק יצאו באתגר גדול המציע הרבה כסף למי שיפתח אלגוריתם שיהיה ממש טוב בזיהוי זיופים. אבל גם אם הם יצליחו, למישהי שיעשו עליה סרט, גם אם הוא לא אמיתי, זה לא ישנה. הדרך היחידה להתמודד היא לפתח אדישות. הרי שימוש בהפשטה הוא כלום לעומת השימושים הפוליטיים שיעשו. סרטונים של מנהיגים עושים דברים נוראיים, ואז נסיונות לשכנע שהסרט מזויף. כבר היום, כשהטכנולוגיה בחיתוליה, אנשים מסרבים לקבל עובדות שנוגדות את מה שהם מאמינים בו. כשיהיו המוני סרטונים שכאלו, מי שיאמין ימשיך להאמין לא משנה מה יגידו לו. אנחנו כולנו נצטרך להתפתח, לבדוק את עצמנו ולהחליט מה חשוב לנו. אבל עד שזה יקרה תהיה תקופת ביניים קשה".

פרופ' הקר דווקא רואה אפשרות לעתיד אחר לחלוטין. "אני דווקא לא חושבת שמה שיקרה הוא שנשים יצטרכו להסתגל. אני רואה יותר ויותר נשים שמחפצנות. במקום שגברים ילמדו להתייחס לנשים כאדם, נשים לקחו את התנהגות הגברים, הן נהנות לשפוט גברים על סמך מראה וכולי. כמו שקרה עם מודל היופי, תחרויות יופי וכדומה. כמו מודל היופי, במקום שנשים ישתחררו ממנו, גם גברים אימצו אותו".

אז במקום שהאפליקציה תיעלם היא תהפוך לדומיננטית גם בקרב נשים?

"זו בהחלט אפשרות. כבר היום יש משהו ברשתות החברתיות שמאפשר את זה. אנחנו לא תלת מימדיים שם, וברגע שיש פחות מימדים אנחנו פלקט. מאוד יכול להיות שנשים יקחו את הפלקט הזה ויעבירו אותו לגברים. אז לא רק נשים יצטרכו להסתגל למצב חדש, גם גברים, ושום דבר טוב לא ייצא מזה. בסופו של דבר, מי שמשתמש בתוכנה כזו לא רק פוגע באדם שהוא הפשיט, אלא גם בעצמו. המשתמש הוא זה שהולך בסוף לאיבוד".